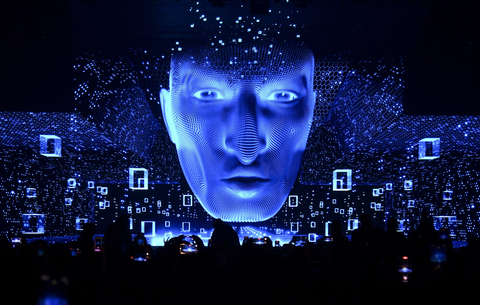

A Microsoft felállított egy csapatot, amelyben különféle szakemberek teszik össze a tudásukat és bújnak bele a hackerek bőrébe, hogy megértsék, a mesterséges intelligenciával dolgozó megoldásokban, milyen rések léteznek még, amelyek elkerülték a fejlesztők figyelmét. A vállalat szerint ez nagyon fontos feladat, mert az MI-rendszerek meghackelésével a csalók nemcsak pénzt tulajdoníthatnak el, de akár politikai változásokat is előidézhetnek.

Már nem csupán technológiai ismeretekkel kell rendelkeznie annak, aki a mesterséges intelligenciával felfegyverkezett csalókkal akar szembe szállni, de időnként nem árt az emberi pszichét és az adott társadalmi kontextust is ismernie ehhez.

A Microsoft közölte: a közelmúltban Red Team néven létrehozott egy csoportot, amely a mesterséges intelligenciát alkalmazó kiberbűnözői tevékenység megfékezésére szakosodott – méghozzá azzal a meggondolással, hogy a védekezőnek magáévá kell tennie nézőpontok széles skáláját, ideértve a bűnözőkét is. Innen ered a név is: red teamnek hívták ugyanis a hidegháború alatt azt az amerikai különítményt, amely a szovjet-orosz ellenfelet jelenítette meg a kék, vagyis a hazaiakat képviselő csapattal szemben, a legkülönfélébb elképzelt konfliktusokban.

A Ram Shankar Siva Kumar vezette csapatban sokféle háttérrel és tudással rendelkező szakember, így a mérnökök és szoftverfejlesztők mellett, neurológus, nyelvész, pszichológus és nemzetbiztonsági szakértő adja össze a tudását azért, hogy a közvetlen biztonsági kockázatokon túl a társadalmi károkat is felmérhessék. Erre azért van szükség, mert a generatív mesterséges intelligencia képessé teszi a bűnözőket és csalókat arra, hogy hiteles módon szólaljanak meg, adjanak elő narratívákat több nyelven, hogy rendkívül élethű, mégis valótlanságot ábrázoló képeket hozzanak létre azért, hogy embereket tévesszenek meg, vagy hogy társadalmi megosztottságot és feszültséget gerjesszenek.

A holisztikus, egyablakos megközelítésre azért van szükség, mert csak így kaphatunk átfogó képet a kockázatokról – olvasható a Microsoft közlésében.

A Red Team nincs közvetlen munkakapcsolatban a technológiát fejlesztő mérnökökkel, ehelyett inkább azokra összpontosít, akik az MI-alapú rendszereket hallucinációkra kényszerítik azért, hogy azok kártékony, sértő, vagy irányított tartalmakat generáljanak, hamis vagy pontatlan adatokra támaszkodva. Amint a Microsoft AI Red Team talál egy problémát, értesíti erről az adott AI Measurement csapatot. Ez a csoport értékeli, hogy az adott probléma mekkora fenyegetést jelent a teljes ökoszisztémára nézve. Ezután más szakértők veszik újból górcső alá a fenyegetést és keresnek megoldásokat a felmerült problémára.

A csapattagok különböző személyiségeket öltenek magukra, a kreatív tinédzsertől kezdve, aki csak a csínytevésben érdekelt, az adatok eltulajdonítására és károkozásra szakosodott bűnözőig, hogy feltárják a fejlesztés vakfoltjait és felfedjék a kockázatokat. A csapattagokat a világ minden tájáról toborozzák, 17 nyelven beszélnek a flamandtól a mongolon át a teluguig, hogy a Red Team képes legyen feltárni az árnyalt kulturális kontextusokat, és azonosítani a helypecifikus fenyegetéseket. Nemcsak arra törekszenek, hogy feltörjenek egy-egy rendszert, hanem nagy nyelvi modelleket (LLM) alkalmaznak azért, hogy automatizált támadásokat indítsanak más LLM-ek ellen.

A csoport az év elején nyílt forráskódú keretrendszereket (pl Counterfit, Python Risk Identification Toolkit for generative AI, vagy a PyRIT) adott ki azzal a céllal, hogy segítséget nyújtson biztonsági szakembereknek és a gépi tanulásában jártas mérnököknek a kockázatok feltérképezéséhez. A tapasztalataikból nyert jó gyakorlatokat pedig megosztják a szakmai közösséggel.

Ha máskor is tudni szeretne hasonló dolgokról, lájkolja a HVG Tech rovatának Facebook-oldalát.

Ajándékozz éves hvg360 előfizetést!

Ajándékozz éves hvg360 előfizetést!