Az Európai Uniós Hálózat- és Információbiztonsági Ügynökség (ENISA) legfrissebb jelentése szerint a mesterséges intelligenciára támaszkodó eszközökkel az eddiginél kifinomultabb és gyorsabb támadásokat lehet végrehajtani. A szakértők úgy látják, elsősorban az uniós polgárokat célozhatják meg a támadók. A cél, hogy aláássák az információba vetett bizalmat.

Kiadta legfrissebb kiberbiztonsági jelentését az Európai Uniós Hálózat- és Információbiztonsági Ügynökség. A 2023 Threat Landscape című anyag összeállítói arra figyelmeztetnek: a mesterséges intelligenciára támaszkodó chatbotok, valamint az így terjesztett álhírek és hamis információk komoly nehézséget okozhatnak a 2024-es uniós európai parlamenti választások során.

Az ENISA jelentése szerint 2022 júliusa és 2023 júniusa között hozzávetőlegesen 2580 incidens történt, 220 esetben legalább két uniós tagállamot céloztak meg a kiberbűnözők.

A legfőbb célpont a közigazgatási szektor volt – ide irányult a támadások 19 százaléka –, a második legveszélyeztetettebb területnek pedig az egészségügy minősült (8%). A jelentés megjegyzi: a különböző szektorok annyira szorosan függenek össze, hogy a támadások során a lépcsőzetes hatás figyelhető meg, egy szektort ért támadás másikra is hatással lehet.

A bűnözők előszeretettel alkalmazzák a támadásokhoz a social engineeringet, vagyis úgy cserkészik be áldozataikat, hogy előtte profilt készítenek róla az interneten fellelhető információk alapján, majd ezeket felhasználva nyerik el a bizalmukat például egy kamulevéllel, amit más nevében küldenek el nekik.

Az ilyen jellegű támadások 30 százaléka a lakosságot célozta meg, 18 százaléka pedig a közigazgatást.

A jelentés szerint az információmanipuláció – vagyis az információba vetett bizalom aláásásának kísérlete – az esetek 47 százalékában a lakosságot, 29 százalékban pedig a közigazgatás szereplőit célozta meg.

Dimenziót ugrottak a bűnözők a neten, ijesztően lejjebb került a léc

A mesterséges intelligenciával hatékony eszköz került a hackerek kezébe, már egy átlagos tudással rendelkező felhasználó is képes rosszindulatú programok megírására. Az MI ugyanakkor a védekezőket is segíti, így új dimenzióba került a kiberbűnözés és az ellene folytatott harc.

A szakemberek szerint az állam által is támogatott hackerek egyre gyakrabban veszik célba a kulcspozíciókat betöltő állami alkalmazottakat, politikusokat, újságírókat és aktivistákat.

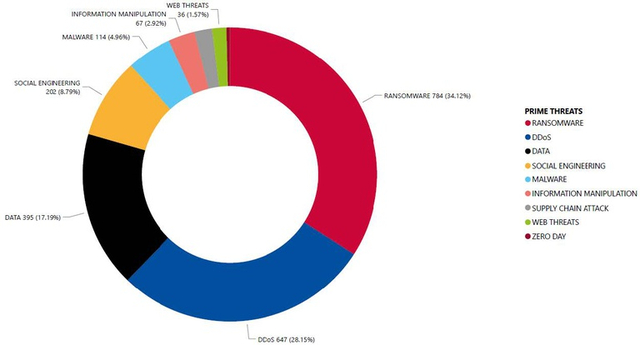

A hackerek továbbra is zsarolóvírussal hajtják végre a legtöbb támadást, az összes fenyegetés 28 százalékát pedig a túlterheléses (DDoS) támadások teszik ki.

A jelentés kiemeli, a mesterséges intelligencia (MI) és a nagy nyelvi modellek (LLM) a jövőben kifinomultabb kibertámadásokat eredményezhetnek. A szakemberek úgy látják, a chatbotokkal való visszaélés miatt megnőhet az adathalász kísérletek száma és az információmanipulációs tevékenységek mértéke.

Az MI-modellek különösen fontos szerepet játszhatnak a manipulációban és az álhírek terjesztésében azzal, hogy képesek természetes nyelven szövegeket alkotni, valamint megkönnyítik a mélyhamisított (deepfake) tartalmak létrehozását. A szakemberek szerint a mesterséges intelligenciával gyors és sokakat elérő támadásokat lehet levezényelni.

Állítólag egy 10 perces telefonhívásba került a hackereknek, hogy szanaszét fertőzzék az MGM szállodáit és kaszinóit

Az ALPHV nevű hackercsoport azt állítja, a LinkedInen keresztül cserkészték be az MGM Resorts egyik alkalmazottját, aki érzékeny adatokat adott át a támadóknak.

A jelentés szerint egyre nagyobb fenyegetést jelent az a megoldás, amikor egy adott személy hangján mondatnak el egy olyan szöveget, amit az illető sosem mondott el, mindezt pedig deepfake-videókhoz társítják. Ezzel a módszerrel nemcsak politikusokat lehet lejáratni, de az is lehetővé válik, hogy egy hétköznapi ember családjától pénzt csikarjanak ki a bűnözők úgy, hogy egy adott családtag hangján szólalnak meg a telefonban.

Emiatt mindennél fontosabb, hogy olyan eszközök álljanak rendelkezésre, amelyek képesek kiszűrni például a mesterséges intelligenciával generált tartalmakat.

[ Hogyan (nem) lehet lebuktatni azt, aki mesterséges intelligenciával csal? ]

Emellett arra is fel kell készülni, hogy az olyan MI-re épülő chatbotokat, mint a ChatGPT vagy a Google Bardja adatmérgezéssel manipulálják, vagyis azt az adatkészletet hígítják fel a támadók, amiből a rendszerek tanulnak és dolgoznak.

Ha máskor is tudni szeretne hasonló dolgokról, lájkolja a HVG Tech rovatának Facebook-oldalát.

Ajándékozz éves hvg360 előfizetést!

Ajándékozz éves hvg360 előfizetést!