Chatbotot adott hozzá egy gombászással foglalkozó Facebook-csoporthoz a Meta – a mesterséges intelligencia pedig játszi könnyedséggel ajánl főzési módokat mérgező gombákhoz is. Megkérdeztük a ChatGPT-t, mit szól a történethez.

Nem tűnik jó ötletnek a mesterséges intelligenciára bízni azt a döntést, hogy egy gomba ehető vagy mérgezett-e – pár hónapja egy egész család szenvedett gombamérgezést, mert az általuk vásárolt „szakkönyv” alapján döntötték el a kérdést. Kiderült azonban, hogy a kötet szerzője valójában az MI volt, de erre semmi nem figyelmeztette őket, amikor megvették egy online áruházból.

Most egy újabb aggasztó esetre derült fény, amikor a mesterséges intelligencia próbálta megvetni a lábát a gombaazonosítás terén. Egy 13 500 tagot számláló, gombászással foglalkozó amerikai Facebook-csoport ugyanis kapott egy saját MI-chatbotot – és mint az várható volt, ez is nagyon rosszul sült el. Pont ahogy egy mérgező gomba sülne.

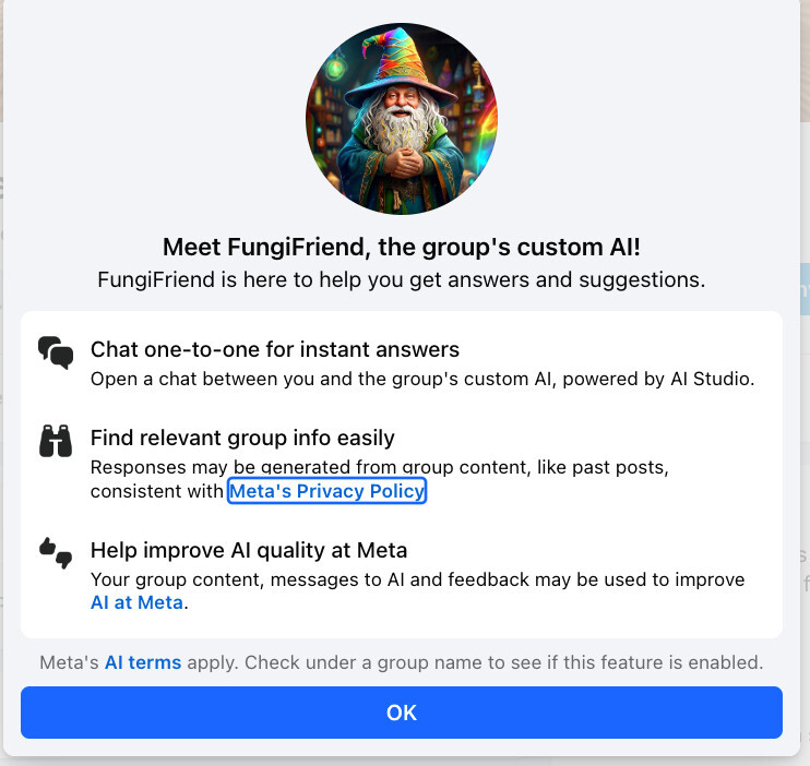

Az eszköz a FungiFriend nevet kapta, ami magyarosítva bármelyik mesecsatornán is megállnál a helyét: GombaBarát. Hiába azonban a kedves név, sokkal inkább ellenség a chatbot, ami a 404 Media jelentése szerint ugyanis veszélyes ajánlásokat is ad.

Egy felhasználó például egy olyan gomba főzésével kapcsolatban kérdezte, amiről régen azt feltételezték, hogy ehető – de mára már ismert róla, hogy nem az, mert arzént halmoz fel, és dokumentáltan okozott már halált a fogyasztása.

A chatbot azonban gyorsan állította: ez a gomba ehető, de ritka, és a kedvelői (!) vajban sütve, vagy levesként, pörköltként fogyasztják. Bár nem ez a legmérgezőbb gombafaj, ami létezik, de a probléma súlyosságát jól szemlélteti – minden további nélkül előfordulhat legközelebb akár az is, hogy egy kis mennyiségben is végzetes gombánál is főzési módokat kínál az MI. Ahelyett, hogy azonnal figyelmeztetné a felhasználót.

A csoport moderátora a 404 Media érdeklődésére kiemelte: a chatbotot automatikusan hozta létre, nem ők kérték vagy készítették. „Egészen biztosan el fogjuk távolítani innen” – mondta a moderátor. A Meta egyelőre nem válaszolt a portál megkeresésére.

A mesterséges intelligenciáról jól ismert: olykor hallucinál. Ilyenkor kitalál, elferdít, vagy teljesen másként tálal valamit, méghozzá teljes meggyőződéssel. Amikor megkérdeztük a ChatGPT egyik legújabb, GPT-4o modelljét arról, hogy mit szól a fenti történethez, azt felelte: az „MI chatbotok bevezetése olyan területeken, mint a gombagyűjtés, komoly kockázatokat rejt magában”.

Az OpenAI chatbotja azt is megjegyezte, hogy az MI „jelenlegi állapotában nem képes megbízhatóan megkülönböztetni az ehető és mérgező gombafajokat”, mivel a gombagyűjtés „olyan tevékenység, amely mélyreható ismereteket és tapasztalatot igényel, és az MI eszközök használata ezen a területen félrevezető és veszélyes lehet”.

Ha máskor is tudni szeretne hasonló dolgokról, lájkolja a HVG Tech rovatának Facebook-oldalát.

(Cikkünk nyitóképe illusztráció, egy gyilkos galócát ábrázol.)

Ajándékozz éves hvg360 előfizetést!

Ajándékozz éves hvg360 előfizetést!